Como é que a ciência pode beneficiar da IA?

Publicação alerta para os equívocos na utilização de algoritmos de previsão

Os investigadores da química, da biologia e da medicina estão a recorrer cada vez mais a modelos de IA para desenvolver novas hipóteses. No entanto, muitas vezes não é claro em que base os algoritmos chegam às suas conclusões e até que ponto podem ser generalizadas. Uma publicação da Universidade de Bona alerta agora para os mal-entendidos no manuseamento da inteligência artificial. Ao mesmo tempo, destaca as condições em que os investigadores podem ter confiança nos modelos. O estudo foi agora publicado na revista Cell Reports Physical Science.

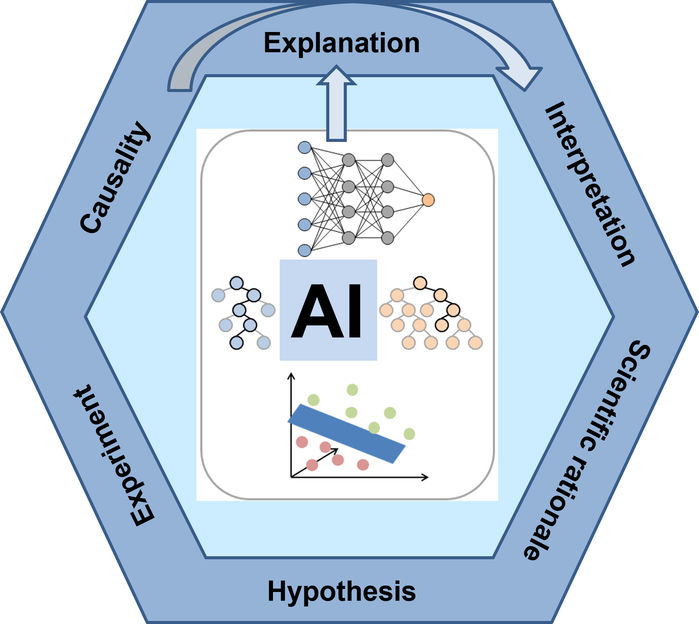

Modelos de IA nas ciências naturais: - Da explicação de previsões à captação de relações causais.

Jürgen Bajorath/University of Bonn

Os algoritmos de aprendizagem automática adaptativa são incrivelmente poderosos. No entanto, têm uma desvantagem: a forma como os modelos de aprendizagem automática chegam às suas previsões não é, muitas vezes, visível do exterior.

Suponhamos que alimentamos a inteligência artificial com fotografias de vários milhares de automóveis. Se lhe apresentarmos agora uma nova imagem, a inteligência artificial consegue normalmente identificar com fiabilidade se a fotografia também mostra um automóvel ou não. Mas porquê? Será que aprendeu realmente que um carro tem quatro rodas, um para-brisas e um escape? Ou será que a sua decisão se baseia em critérios que são, na verdade, irrelevantes - como a antena no tejadilho? Se fosse esse o caso, também poderia classificar um rádio como um automóvel.

Os modelos de IA são caixas negras

"Os modelos de IA são caixas negras", sublinha o Prof. Dr. Jürgen Bajorath. Dr. Jürgen Bajorath. "Por isso, não se deve confiar cegamente nos seus resultados e tirar conclusões a partir deles." O especialista em química computacional dirige o departamento de IA em Ciências da Vida no Instituto Lamarr de Aprendizagem Automática e Inteligência Artificial. É também responsável pelo programa Life Science Informatics no Centro Internacional de Tecnologia da Informação de Bona-Aachen (b-it) da Universidade de Bona. Na publicação atual, investigou a questão de saber quando é que se pode confiar nos algoritmos. E vice-versa: quando não.

O conceito de "explicabilidade" desempenha um papel importante neste contexto. Em termos metafóricos, refere-se aos esforços da investigação em IA para abrir um buraco na caixa negra. O algoritmo deve revelar os critérios que utiliza como base - as quatro rodas ou a antena. "Abrir a caixa negra é atualmente um tema central na investigação em IA", afirma Bajorath. "Alguns modelos de IA são desenvolvidos exclusivamente para tornar os resultados de outros mais compreensíveis."

A explicabilidade, no entanto, é apenas um aspeto - a questão das conclusões que podem ser retiradas dos critérios de decisão escolhidos por um modelo é igualmente importante. Se o algoritmo indicar que baseou a sua decisão na antena, um ser humano sabe imediatamente que esta caraterística é pouco adequada para identificar automóveis. Apesar disso, os modelos adaptativos são geralmente utilizados para identificar correlações em grandes conjuntos de dados que os humanos podem nem sequer notar. Somos então como extraterrestres que não sabem o que faz um automóvel: Um extraterrestre seria incapaz de dizer se uma antena é ou não um bom critério.

Modelos de linguagem química sugerem novos compostos

"Há outra questão que temos sempre de nos colocar quando utilizamos procedimentos de IA na ciência", sublinha Bajorath, que também é membro da Área de Investigação Transdisciplinar (TRA) "Modelação": "Até que ponto os resultados são interpretáveis?" Os modelos de linguagem química são atualmente um tema quente na investigação química e farmacêutica. É possível, por exemplo, alimentá-los com muitas moléculas que têm uma determinada atividade biológica. Com base nestes dados de entrada, o modelo aprende e, idealmente, sugere uma nova molécula que também tenha essa atividade, mas com uma nova estrutura. Este processo é também designado por modelação generativa. No entanto, o modelo geralmente não consegue explicar porque é que chegou a esta solução. É frequentemente necessário aplicar posteriormente métodos de IA explicáveis.

No entanto, Bajorath adverte contra a interpretação excessiva destas explicações, ou seja, a antecipação de que as caraterísticas que a IA considera importantes causam efetivamente a atividade desejada. "Os modelos actuais de IA não percebem essencialmente nada de química", afirma. "São puramente estatísticos e correlativos por natureza e prestam atenção a quaisquer caraterísticas distintivas, independentemente de estas caraterísticas serem química ou biologicamente relevantes ou não." Apesar disso, podem até ter razão na sua avaliação - talvez a molécula sugerida tenha as capacidades desejadas. No entanto, as razões para tal podem ser completamente diferentes do que seria de esperar com base no conhecimento químico ou na intuição. Para avaliar a potencial causalidade entre as caraterísticas que determinam as previsões e os resultados dos processos naturais correspondentes, são normalmente necessárias experiências: Os investigadores têm de sintetizar e testar a molécula, bem como outras moléculas com o motivo estrutural que a IA considera importante.

Os controlos de plausibilidade são importantes

Estes testes são demorados e dispendiosos. Bajorath alerta para o facto de não se interpretarem excessivamente os resultados da IA na procura de relações causais cientificamente plausíveis. Na sua opinião, um controlo de plausibilidade baseado numa fundamentação científica sólida é de importância crucial: Poderá a caraterística sugerida pela IA explicável ser efetivamente responsável pela propriedade química ou biológica desejada? Vale a pena seguir a sugestão da IA? Ou será um artefacto provável, uma correlação identificada aleatoriamente, como a antena do carro, que não é de todo relevante para a função real?

O cientista sublinha que a utilização de algoritmos adaptativos tem, fundamentalmente, o potencial de fazer avançar substancialmente a investigação em muitos domínios da ciência. No entanto, é preciso estar ciente dos pontos fortes destas abordagens - e particularmente dos seus pontos fracos.

Observação: Este artigo foi traduzido usando um sistema de computador sem intervenção humana. A LUMITOS oferece essas traduções automáticas para apresentar uma gama mais ampla de notícias atuais. Como este artigo foi traduzido com tradução automática, é possível que contenha erros de vocabulário, sintaxe ou gramática. O artigo original em Inglês pode ser encontrado aqui.